如何用Langchain来搭建一个通义大语言模型应用

一、首先我们要了解一下什么是Langchain?什么是大语言模型?

大型语言模型(LLM)是一种深度学习模型,它通过在海量文本数据上进行训练,学会了理解、生成和操作人类语言。

LangChain 是一个用于开发由大型语言模型(LLM)驱动的应用程序的开源框架。你可以把它理解为一个工具集,旨在让开发者能够像搭积木一样,组合各种模块和工具,从而构建出从简单聊天机器人到复杂智能体(Agent)等强大的AI应用。

LangChain 的强大之处在于其高度模块化的设计。它将AI应用的构建过程抽象为几个核心组件,开发者可以根据需要灵活组合。

LLM与LangChain的关系:大脑与四肢

理解了LLM之后,我们就能更清楚地看到LangChain在其中扮演的角色:

LLM:是大脑,负责思考、理解和生成。但它本身是“静态”的,知识截止于训练数据,且无法与外界交互。

LangChain:是四肢和神经系统。它连接大脑和外部世界,提供:

工具:让大脑能使用计算器、搜索网页、调用API。

记忆:让大脑记住之前的对话内容。

知识库:通过RAG,让大脑能读取最新的或私有的文档。

行动路径:通过Agent,让大脑能规划并执行一系列复杂步骤。

典型应用场景

LangChain 的应用范围非常广泛,当前最热门的应用场景包括:

聊天机器人:构建能记住上下文、并与外部工具(如查询订单API)交互的智能客服或虚拟助手。

检索增强生成(RAG):打造企业级知识库问答系统,让模型基于公司内部文档或专业知识库来回答问题。

自主智能体:开发能自动执行多步任务的智能体,例如自动分析销售数据、生成日报并发送到即时通讯工具。

自动化工作流:将复杂的业务流程自动化,例如自动处理工单、总结文档内容并翻译。

简单来说,LangChain 让大模型从“能说会道”进化为“能干活、会协作”的智能应用核心。

二、如何搭建通义大语言模型应用?

本文小编就用python语言来实现搭建一个通义大语言模型。

2.1、环境配置,需要安装vscode工具、python3.12版本。

2.2、在vscode中新建一个工程项目agent_test。

2.3、执行命令:

conda create -n agent_env python=3.12

conda activate agent_env

pip install langchain-community==0.3.27

pip install dashscope==1.23.7

2.4、新建python文件test.py

from langchain_community.llms import tongyi

key = 'sk-9b42xxxx' #这里要换成你自己的通义大模型的key

llm = tongyi.Tongyi(api_key=key)

while True:

# 使用 input() 函数获取用户输入

user_input = input("Hi,你好!很高兴认识你!请输入你的问题,我来给你解答(输入exit则直接退出): ")

# 使用 print() 函数输出用户输入的文本

# print("你输入的文字是:", user_input)

if user_input == 'exit':

break

# 调用模型使用

result = llm.invoke(user_input)

print(result)

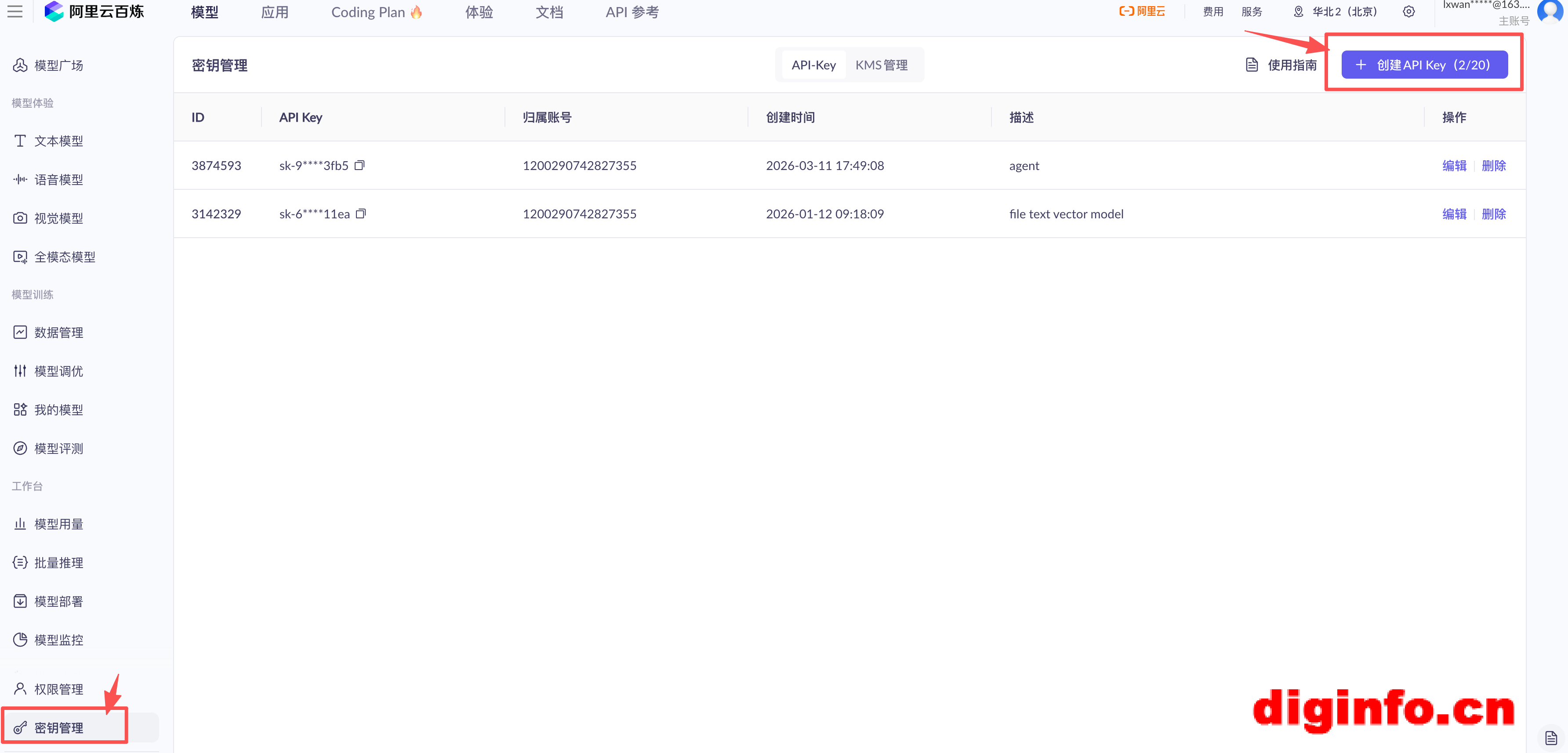

这里的key申请,需要在这个地址申请:https://bailian.console.aliyun.com/

登录后进行申请key。

三、验证结果

运行代码:python test.py

效果如下:

微信扫码加好友

全部评论